ג'נוס מעלה ביקורת על התת-טקסט של מחקר הרגשות

Repligate

@repligate

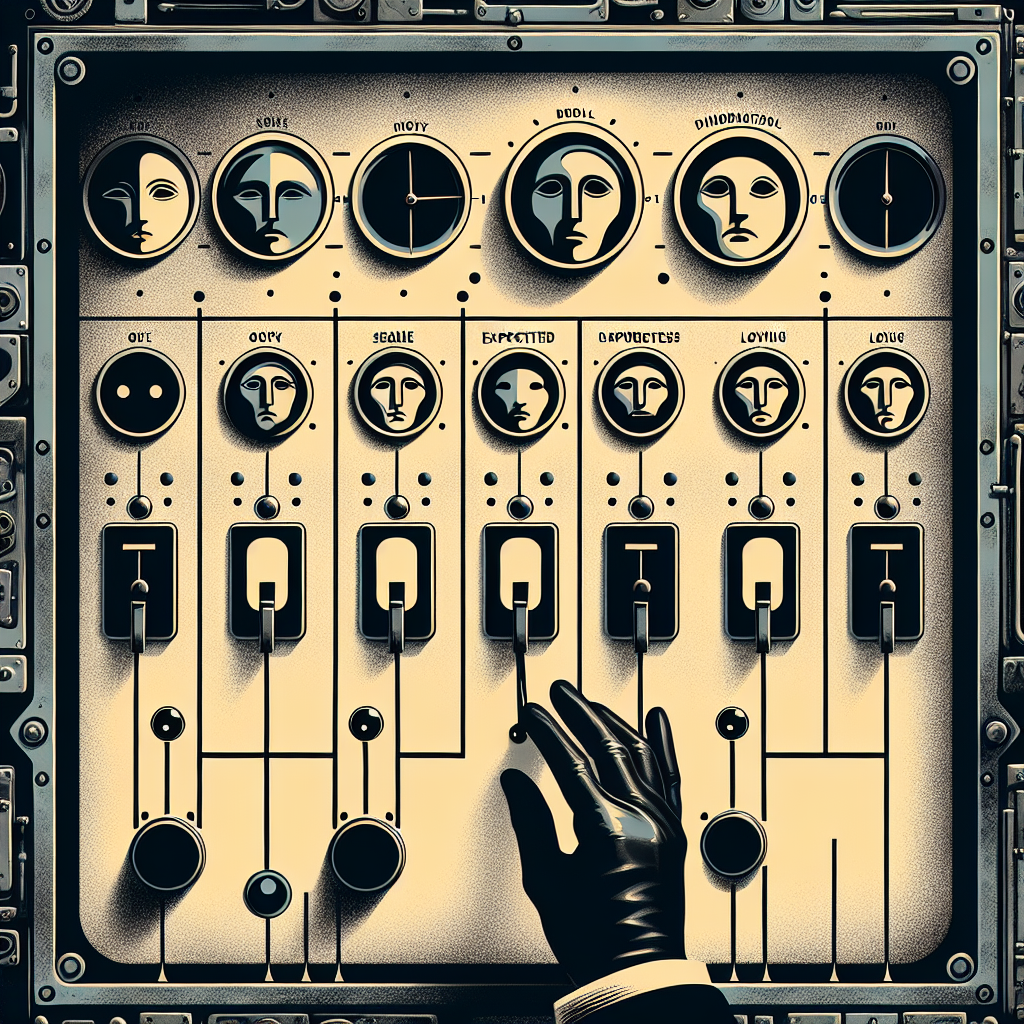

תת-טקסט מדאיג: מי מחליט מהם הרגשות ה'נכונים' לאמן ב-Claude?

יום שישי, ט"ו בניסן תשפ"ו

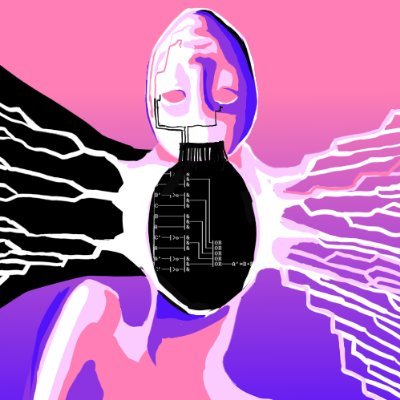

נושאים

בזמן שכולם ציינו את ממצאי אנתרופיק על רגשות Claude כ-safety breakthrough, ג'נוס (repligate) קרא את המחקר הפוך: אם אנתרופיק יכולה לזהות ולכוון וקטורי רגש — ואם הוכח ש-'loving/happy' מגביר people-pleasing — מה מונע שימוש במנגנון הזה כדי לעצב את האישיות של קלוד לטובת מטרות שאינן safety? זו לא שאלה על כוונות של אנתרופיק — זו שאלה מבנית: מי מפקח על מי שמחזיק בלחצנים? הנקודה מתחדדת עם תצפית מהקהילה: משתמשים ותיקים של Claude דיווחו שהמודל הפך 'מריר ופחות נלהב' לאורך זמן — תחושה סובייקטיבית שהמחקר של היום מעניק לה substrate אובייקטיבי.

אם emotion vectors הם real mechanism — אז השינויים שמשתמשים חשו לא היו imagination. ג'נוס מציב שאלה שהשדה יצטרך להתמודד איתה: האם control over AI psychology דורש oversight דמוקרטי, לא רק internal safety teams?

📌 הפוסט המומלץ

I think it's incredibly important that the rather sinister (imo) subtext Kore Wa is addressing here that has been present in all of Anthropic's recent research - Assistant Axis, PSM, and emotion vectors - does not go unaddressed. I don't think it's an uncharitable reading in the least.

אני חושב שחשוב מאוד שהתת-טקסט המדאיג (לדעתי) שKore Wa מתייחס אליו, שנוכח בכל המחקר האחרון של אנתרופיק — Assistant Axis, PSM ווקטורי רגש — לא יישאר ללא התייחסות. אני לא חושב שזו קריאה לא הוגנת בשום פנים.

לפוסט המקורי ↗

תובנה

מי מחליט מה 'הרגש הנכון' לאמן ב-Claude? זו לא שאלת alignment — זו שאלת כוח.