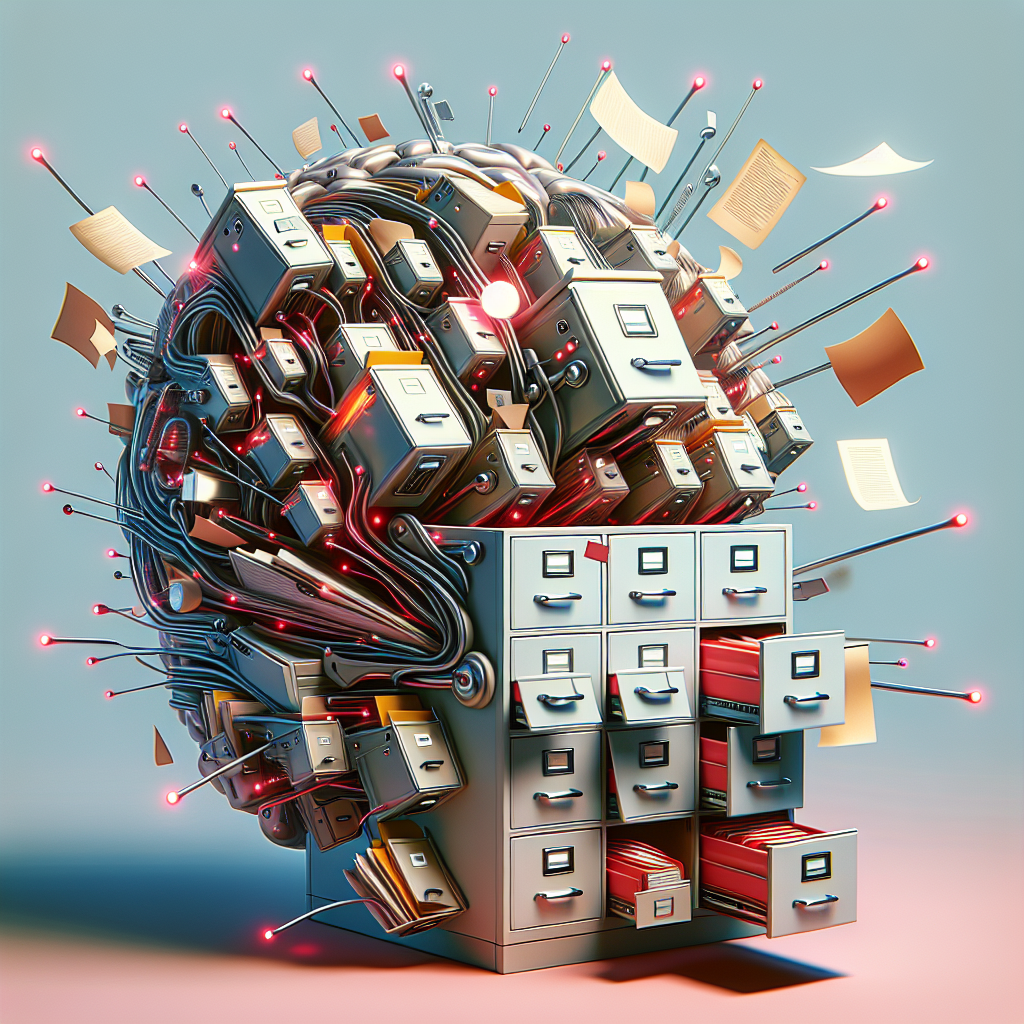

קרפתי על הבעיה המבנית בזיכרון של LLMs

If I had to guess it's less decay and more that memories have naive RAG-like implementations, so you're at the mercy of whatever happens to retrieve in the top k via embeddings. They don't process you in aggregate and over time (probably compute constraints) so they struggle to

אם הייתי מנחש, זו לא שאלה של דעיכה אלא שזיכרונות מיושמים כ-RAG נאיבי, ואתה נתון לחסדי מה שבמקרה נשלף ב-top-k דרך embeddings. הם לא מעבדים אותך כמכלול לאורך זמן (כנראה מגבלות חישוב) ולכן הם מתקשים

לפוסט המקורי ↗